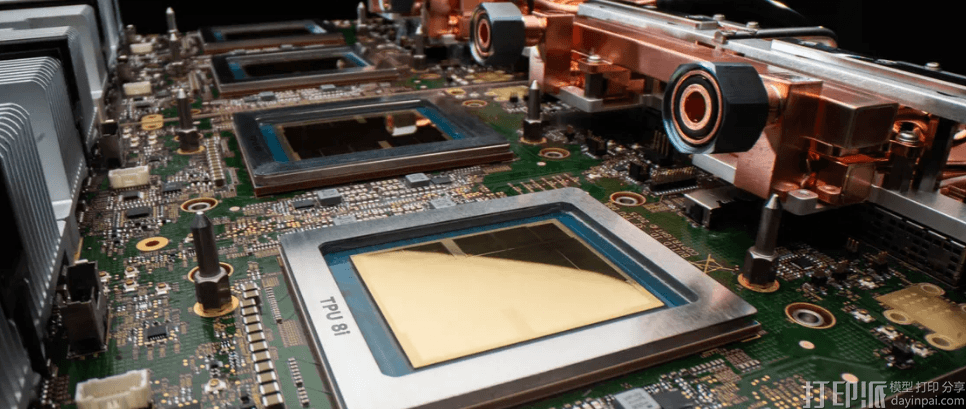

在Google Cloud Next大会上,谷歌正式发布了第八代张量处理单元(TPU),针对模型训练和推理分别推出两款定制AI芯片——TPU 8t和TPU 8i。随着大规模AI计算需求激增,这两款芯片旨在为谷歌的AI超算平台提供算力支持,覆盖从训练前沿模型到为生产环境中的AI智能体提供服务的各类工作负载。

TPU是谷歌自研的加速器,多年来已为其内部Gemini等系统提供算力。如今,谷歌正将这些硬件扩展给那些希望在英伟达主导的AI基础设施之外寻求替代方案的客户。谷歌表示,两款芯片将于今年晚些时候全面上市。

TPU 8t专为训练大型AI模型优化。谷歌称,单个超级计算机组可扩展至9600颗芯片,提供121 exaflops的计算性能。与前代Ironwood相比,每pod的计算性能提升了近3倍。训练系统还升级了更快的存储访问和网络连接,以确保芯片持续处于工作状态而非等待数据。谷歌表示TPU 8t的目标是达到超过97%的“有效吞吐率”(goodput),用于衡量有效计算时间而非因故障或瓶颈造成的空闲时间。

TPU 8i则聚焦推理——即训练好的AI模型回答问题、运行工具和为软件智能体提供动力的阶段。该芯片配备288 GB高带宽内存和384 MB片上SRAM,使活动模型数据更接近处理器,从而加快响应速度。它还采用谷歌基于Arm架构的Axion CPU和升级的MoE模型互连带宽。谷歌表示,TPU 8i的每美元性能比前代提升80%,客户可以在相同成本下处理近两倍的工作负载。

此次发布凸显了AI基础设施正从通用GPU向针对不同工作负载调优的专用芯片转变。谷歌称,双芯片策略受到AI智能体兴起的推动——这些智能体需要能够推理任务、运行工作流并与工具及其他模型反复交互的系统。在数据中心,两款芯片的每瓦性能比Ironwood提升高达2倍,并采用第四代液冷技术以在控制功耗的同时支持更高计算密度。

TPU 8t和TPU 8i均将于今年晚些时候通过Google Cloud提供。谷歌表示,这些芯片还支持JAX、PyTorch、SGLang和vLLM等框架,使开发者无需大量重写软件即可运行现有AI工作负载。

20 0

登陆后参与评论

2026-04-23 09:50:26

2026-04-22 09:47:09

2026-04-22 09:34:28

2026-04-21 09:23:15

2026-04-21 09:22:01

2026-04-21 09:20:24

2026-04-21 09:15:19

2026-04-20 09:18:52

2026-04-20 09:15:23

2026-04-20 09:03:41

2026-04-17 09:36:36

2026-04-17 09:23:44